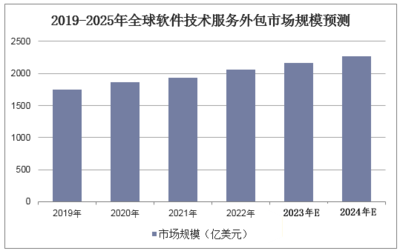

服務(wù)外包是指企業(yè)將非核心業(yè)務(wù)或特定功能委托給外部專業(yè)服務(wù)提供商來執(zhí)行的管理模式。關(guān)于服務(wù)外包,以下是針對(duì)選項(xiàng)的詳細(xì)分析:

對(duì)于選項(xiàng)a,服務(wù)外包確實(shí)是未來企業(yè)的發(fā)展趨勢(shì),因?yàn)樗梢詭椭髽I(yè)降低運(yùn)營成本、提高效率和專注于核心業(yè)務(wù)。說“其產(chǎn)生利潤將超過產(chǎn)品貿(mào)易”可能過于絕對(duì),取決于行業(yè)和市場(chǎng)環(huán)境,不能一概而論。因此,a不完全準(zhǔn)確。

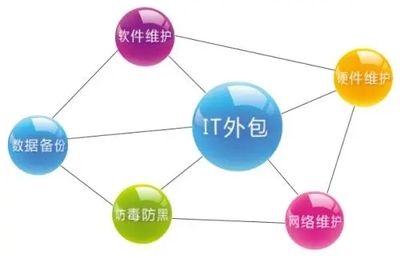

對(duì)于選項(xiàng)b,以軟件業(yè)服務(wù)外包為例,它通常依托互聯(lián)網(wǎng)技術(shù),通過外部團(tuán)隊(duì)的協(xié)作和迅速響應(yīng)市場(chǎng)變化,能加快產(chǎn)品更新升級(jí)速度,提高競(jìng)爭(zhēng)力。這被認(rèn)為是相對(duì)正確的說法。

對(duì)于選項(xiàng)c,指出服務(wù)外包一般不需要中間環(huán)節(jié),尤其是在軟件外包領(lǐng)域可能直接【銜接或報(bào)價(jià)錯(cuò)誤,應(yīng)判斷源文本】,實(shí)際上外包可能需要中間協(xié)調(diào)或管理環(huán)節(jié)來確保合作順暢。根據(jù)表述,這一定義可能片面。

綜合評(píng)述,選項(xiàng)b更有理論基礎(chǔ)支持,因此簡(jiǎn)單摘要為較好關(guān)注促進(jìn)升級(jí)發(fā)展方向的內(nèi)容。(注:題目源自知識(shí)點(diǎn)篩查。)